En ocho días, Anthropic soltó cuatro cosas seguidas. Claude for Word. Claude Mythos, bendecido por el AI Safety Institute del UK. Opus 4.7, arriba en casi todos los benchmarks agenticos. Y Claude Design, que tumbó a Figma un 7% ese mismo día.

La misma semana, OpenAI tuvo esto: un memo interno filtrado atacando a Anthropic, ocho cargos ejecutivos fuera o en transición en dos semanas, un artículo del New Yorker describiendo a Altman como "mentiroso patológico", y un modelo flagship prometido que nunca llegó.

Nadie sabe cómo va a terminar esta carrera, pero a OpenAI no le está yendo muy bien ahora.

Qué Speed tiene Anthropic

Cuatro productos y un sello del gobierno británico. Cada uno funciona solo. Juntos son la mejor semana de producto que ha tenido Anthropic en su historia.

Claude for Word

Empezó con lo más discreto. Claude for Word se lanzó como add-in nativo en Microsoft AppSource. Se suma a los de Excel (octubre 2025) y PowerPoint (febrero 2026) para cerrar la suite Office. Sidebar con document awareness, marcado en rojo y verde dentro del review panel de Word. Útil sobre todo para revisar contratos legales.

No suena a titular. Pero cerrar Word significa que Claude vive ahora dentro del producto más usado de Microsoft, al lado de Copilot, mirándolo. Eso dice bastante de la estabilidad real de la relación OpenAI-Microsoft y de quién es el gran partner en 2026.

Mythos validado por el Estado británico

El AI Safety Institute del Reino Unido publicó una evaluación independiente de Claude Mythos, el modelo de ciberseguridad que Anthropic anunció en marzo y decidió no liberar al público.

En CTF nivel experto, Mythos acertó el 73%. En "The Last Ones" (una simulación de ataque corporativo de 32 pasos, 20 horas de trabajo humano experto), Mythos lo resolvió entero 3 de cada 10 intentos. Promedio: 22 de los 32 pasos. Opus 4.6, el segundo mejor, llegó a 16. Mythos es el primer modelo en la historia que resuelve TLO de principio a fin.

No es la primera vez que un lab dice "es tan peligroso que no podemos liberarlo". OpenAI hizo exactamente lo mismo con GPT-2 en 2019. Al final se liberó, el mundo siguió girando, y nadie se acuerda. Me huele más a marketing que a peligro real. Pero habrá que verlo.

Bruce Schneier, uno de los criptógrafos más respetados del mundo, publicó ese mismo día un análisis crítico. Admitió que la amenaza es real. Pero igual terminó con una frase que a Anthropic le duele y le halaga en partes iguales:

"This is very much a PR play by Anthropic. And it worked."

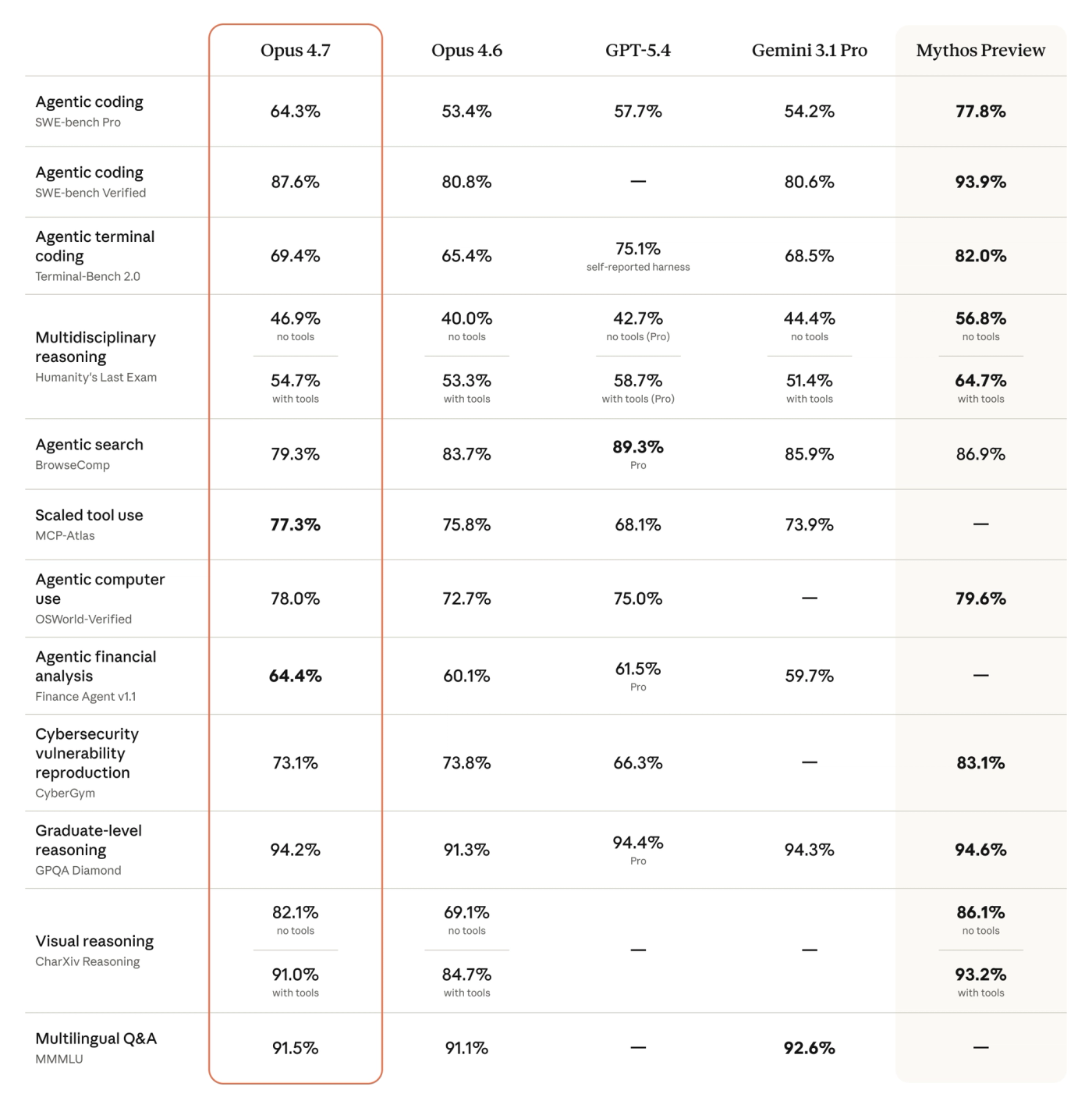

Opus 4.7

Nuevo modelo y algunas cosas aún no cambian.

¿Es realmente mejor el modelo 4.7 vs el 4.6??

En Reddit, un post titulado "Claude Opus 4.7 is a serious regression, not an upgrade" acumuló 2.300 upvotes en 24 horas. En el thread 47793546 de Hacker News los devs se pusieron a discutir si el salto 4.5 → 4.6 → 4.7 en tres meses tiene justificación real. No todos están en contra: Jeremy Howard lo llamó "el primer modelo que entiende lo que estoy haciendo", Garry Tan (YC) y Ryo Lu (Cursor) lo endosaron. Pero el consenso que emerge en foros técnicos no es "salto generacional". Es "parche con algunos fixes".

Personalmente, hasta ahora no siento ninguna diferencia sustancialmente abismal, lo veo más como un paso adelante, pero no un salto generacional.

Los benchmarks oficiales de Anthropic no desmienten esa lectura:

El precio oficial no cambió. $5 por millón de tokens de entrada, $25 por millón de salida. Los mismos que 4.6.

Lo que sí cambió fue el tokenizer.

Explicación rápida: el modelo no lee palabras, lee trozos. El tokenizer es la máquina que decide cómo trocea tu texto, y cada trozo es un token. Te cobran por token. Si el nuevo tokenizer parte tu texto en más trozos, pagas más por el mismo texto. Aunque el precio por token no haya cambiado.

El nuevo tokenizer de Opus 4.7 multiplica los mismos inputs entre 1,0x y 1,35x. En código, datos estructurados y español, se nota más. Para un equipo que corre agentes SWE autónomos (un agente SWE es una IA programando sola: lee código, escribe cambios, corre tests. Claude Code, Cursor Agent o Devin son ejemplos. Queman muchísimos tokens) que procesan 10 millones de tokens de entrada y 2 millones de salida al día, la factura mensual pasa de $3.000 a $4.050. La comunidad se dio cuenta en 48 horas. Pero curiosamente nunca lo mencionaron en ninguna página de pricing.

"Feels like the pre-nerf build of 4.6 dressed in a higher model number, slipped out the door with a tokenizer change that functions as a stealth price hike." (HN thread 47793546)

Claude Design, o cómo Figma perdió un 7% en una tarde

Anthropic lanzó Claude Design, una herramienta que convierte prompts en prototipos, slides, wireframes y material de marketing. Suena a otro producto de IA haciendo imágenes bonitas. Al parecer no lo es. La gente ya está construyendo con él.

Claude Design extrae el design system directamente de un repo de GitHub (colores, tipografía, componentes) y lo aplica a cada proyecto que generes. Hace handoff a Claude Code listo para producción. Exporta a Canva, PDF, PowerPoint, HTML y URLs compartibles. Brilliant reportó que tareas que antes tomaban "20 prompts en otras herramientas" ahora requieren 2. Un dev apuntó Claude Design al repo iOS de su empresa y obtuvo un prototipo que replicó el visual language del app existente sin instrucciones adicionales.

Figma cayó 7% ese viernes 💀. Un 84% acumulado en lo que va de año.

Y ojo con esto. Mike Krieger, CPO de Anthropic y cofundador de Instagram, abandonó el consejo de Figma días antes del lanzamiento. El conflicto de intereses es más que real.

Claude for Word, Mythos validado, Opus 4.7, Claude Design. Cuatro piezas, ocho días, un calendario. Cada una refuerza a la siguiente.

El memo que se filtro

El domingo 12 de abril, Denise Dresser, Chief Revenue Officer de OpenAI, mandó un memo interno atacando a Anthropic. Para el lunes lo tenían The Verge, CNBC y Gizmodo. Algo que se filtra tan rápido dice bastante de la situación organizacional interna.

La acusación. Anthropic reporta $30.000M de ARR usando reconocimiento bruto, contabilizando el 100% de lo que pasa por AWS Bedrock y Google Cloud (incluida la parte que se queda Amazon y Google). Ajustado al método neto (el que usa OpenAI con Microsoft), Anthropic cae a $22.000M y OpenAI queda en $25.000M, por delante. Ambos métodos son GAAP-válidos. No es fraude. Es otra forma de contar resultados. Una medida un poco pirata: atacar a la competencia desde un memo interno para mantener "el trono".

Atacando a la competencia. El memo ataca el compute de Anthropic: "strategic misstep to not acquire enough compute is showing up in the product". Throttling, menor disponibilidad, peor experiencia. Dos días después, Fortune reportó backlash masivo por degradación de Claude y CNBC confirmó un outage el 15 de abril. Dresser acertó el diagnóstico y lo puso en portada. Publicidad gratuita para el dolor del rival.

La confesión. El mismo memo admite que la relación con Microsoft "has limited our ability to meet enterprises where they are. For many that's Bedrock." Traducción: Microsoft no nos deja vender por AWS, y los clientes enterprise quieren AWS. OpenAI está girando hacia Amazon como canal primario, algo que Microsoft lleva años intentando evitar. La pregunta que el propio memo deja sobre la mesa, sin querer:

Is the OpenAI-Microsoft partnership collapsing?

Y recuerda: Microsoft tiene el 49% de OpenAI. Si la respuesta a esa pregunta es "sí", la valoración de $852.000 millones de OpenAI aguanta bastante menos de lo que le están vendiendo a los inversores.

La promesa que no llegó. Dresser adelanta un modelo interno con codename "Spud" que va a "hacer todos nuestros productos significativamente mejores". Polymarket le daba 78% de probabilidad de salir antes del 30 de abril. Estamos a 19. Sin tweet, sin blog, sin modelo.

La respuesta de Anthropic al memo: silencio. Dario Amodei no salió ni en X, ni en podcast, ni en conferencia de prensa. Con un rival que se dispara en el pie delante de toda la prensa, no hacía falta más.

Claro, ahora todos hacen IA

Una empresa de zapatillas sostenibles subió 582% en un día de bolsa. Se llama Allbirds, cotiza con el ticker BIRD, y pasó de $21M a $210M de market cap en una sola sesión.

¿Qué hicieron? Vendieron la marca de zapatillas a American Exchange Group por $39M, cerraron un convertible de hasta $50M y anunciaron que se convierten en NewBird AI, un proveedor de GPU-as-a-Service. No tienen experiencia en data centers. Ni en networking. Ni en cooling. Sus competidores directos (CoreWeave, Lambda Labs) llevan años con infraestructura probada. $50M no llega ni para empezar a competir. Analistas mantienen rating de "Reduce" con precio objetivo de $8.

Al final, nada importó. Solo bastó añadir "AI" al nombre. 🤦

Algunos dicen que estamos en una burbuja. Cosas como esta me hacen pensar que sí lo estamos.

Mi recomendación para esta semana

Una sola cosa. Testea Claude Design.

Que ya empezaron los gurús a matar a la industria del diseño...

Yo lo voy a hacer esta semana. Si algo merece contarse, va en la próxima resaca.

Lo que no te van a contar 🍷

Atacan a Altman 2 veces en una semana. El viernes 10 de madrugada, un hombre de 20 años llegado desde Texas lanzó una molotov contra la puerta de la casa de Altman en San Francisco. Llevaba un manifiesto de 20 páginas titulado "Your Last Warning" y una lista de CEOs de IA como objetivos. El domingo hubo un segundo ataque: un coche pasó por la casa y alguien disparó un tiro. El agresor de la molotov fue acusado de dos cargos de intento de asesinato y el DOJ evalúa cargos de terrorismo doméstico.

Ocho cargos ejecutivos fuera en dos semanas. Brad Lightcap (COO) reubicado el 3 de abril. Fidji Simo (chief product) de baja médica. Kate Rouch (CMO) por tratamiento. Kevin Weil (ex-CPO), Bill Peebles (director Sora, proyecto cancelado) y Srinivas Narayanan (CTO B2B) saliendo el mismo viernes 17, el mismo día que Anthropic lanzaba Claude Design. Si sumamos a Ilya Sutskever y Mira Murati (salidas anteriores), son ocho cargos críticos en movimiento. La narrativa oficial dice "reestructuración". La lectura en X es éxodo masivo y guerra por el talento. El viernes 10, Ronan Farrow (el periodista que destapó el caso Weinstein y ganó el Pulitzer por ello) publicó en The New Yorker un perfil demoledor de Altman. 18 meses de investigación. 16.000 palabras. Más de 100 fuentes entrevistadas. Un dossier de 70 páginas de conversaciones internas de Slack compilado por Sutskever antes de irse. La conclusión, en palabras del propio artículo: Altman es un "mentiroso patológico" y un manipulador sistemático al que no se le debería confiar una tecnología de este tamaño. Él lo llamó "incendiario". Nadie te va a confirmar que el éxodo sea por el artículo, pero el calendario no deja muchas dudas: te describen así un viernes, tus mejores ejecutivos firman la salida el lunes siguiente.

Los labs cada vez tapan más cosas. El Stanford AI Index 2026 salió el miércoles. La mitad de titulares (adopción del 88%, SWE-bench saltó de 60% a 100% en un año, IA generativa alcanzó 53% de adopción más rápido que internet) son para aplaudir. La otra mitad nadie quiere citarla: el Foundation Model Transparency Index cayó de 58 a 40 puntos, los investigadores de IA llegando a EE.UU. se desplomaron 89% en 7 años, y el 52% de la población global dice que siente "nerviosismo" ante la IA. Cada vez más poder concentrado en menos empresas. Y esas empresas, cada vez menos transparentes.

Antes de cerrar

AMD le arrebató $60.000 millones a Nvidia.

Canva lanzó 2.0 el mismo viernes que Claude Design.

DeepSeek V4 entrena en chips Huawei, no Nvidia.

Snap despidió al 16% de su plantilla y su acción subió 7%.

Oracle despidió a 30.000 personas con un email a las seis de la mañana.

El 29% de empresas que despidieron por IA ya están recontratando.

Mi take

Claude no para de sorprenderme por la cantidad de cosas que lanza al mercado. Sin duda un equipo de producto Tier 1 ahora mismo. Pero tendría mucho cuidado con el discurso de Mythos. OpenAI ya dijo hace 7 años que uno de sus modelos era "demasiado peligroso para publicarlo" y al final fue un ejercicio de marketing. Lo mismo con todo el ruido que vamos a ver esta semana alrededor de Claude Design. Aún no lo pruebo, pero ojo con separar lo real del clickbait.

Lo de BIRD me causa entre gracia, preocupación y un poco de "vaya huevos". La empresa no iba bien, iban a palmar igual, y este pivot es bastante arriesgado. Espero que les funcione.

Una semana de muchas cosas de Claude. OpenAI siento que va perdiendo terreno a nivel performance y a nivel aceptación social. Al final nunca sabemos qué va a pasar. Estas cosas cambian cada trimestre y dependen mucho de quién lidera.

Y para mis amigos emprendedores, no emprendedores, y todos los que me leen: estamos sin lugar a dudas en el momento más importante a nivel tecnológico de la humanidad. Exploren, jueguen, construyan, inviertan en aprender. Esto es el futuro.

Nos vemos el próximo domingo.